1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

|

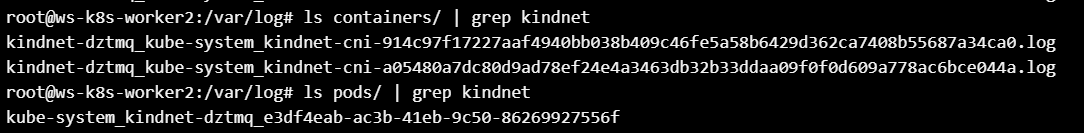

02_output.conf: |-

<match kube.net.kindnet>

@type stdout

</match>

...

helm upgrade --install fluentd . -f ./values.yaml -n fluent

可以看到日志的格式为:

I0402 08:41:30.590752 1 main.go:297] Handling node with IPs: map[172.19.0.3:{}]

↓

level: I

k8s_timestamp: 0402 08:41:30.590752

pid: 1

source_file: main.go

line: 297

message: Handling node with IPs: map[172.19.0.3:{}]

01_filter.conf: |-

<filter kube.net.kindnet>

@type parser

key_name log

reserve_data true

remove_key_name_field true

<parse>

@type regexp

expression /^(?<level>[IWEF])(?<date>\d{4})\s+(?<time>\d{2}:\d{2}:\d{2}\.\d{6})\s+(?<pid>\d+)\s+(?<file>[^:]+):(?<line>\d+)\]\s+(?<message>.*)$/

</parse>

</filter>

<filter kube.net.kindnet>

@type record_transformer

enable_ruby true

<record>

level_name ${ {"I"=>"INFO", "W"=>"WARN", "E"=>"ERROR", "F"=>"FATAL"}[record["level"]] }

clean_status "success"

processed_at ${Time.now.to_s}

processed_by "fluentd-aio-cleaner"

</record>

</filter>

helm upgrade --install fluentd . -f ./values.yaml -n fluent

2026-04-02 09:03:31.181201000 +0000 kube.net.kindnet: {"time":"2026-04-02T09:03:31.181227255Z","stream":"stderr","_p":"F","kubernetes":{"pod_name":"kindnet-dztmq","namespace_name":"kube-system","pod_id":"e3df4eab-ac3b-41eb-9c50-86269927556f","labels":{"app":"kindnet","controller-revision-hash":"5b49848c94","k8s-app":"kindnet","pod-template-generation":"1","tier":"node"},"host":"ws-k8s-worker2","pod_ip":"172.19.0.3","container_name":"kindnet-cni","docker_id":"914c97f17227aaf4940bb038b409c46fe5a58b6429d362ca7408b55687a34ca0","container_hash":"sha256:50415e5d05f05adbdfd902507532ebb86f924dc2e05511a3b47920156ee4236e","container_image":"docker.io/kindest/kindnetd:v20241108-5c6d2daf"},"level":"I","date":"0402","pid":"1","file":"main.go","line":"324","message":"Node ws-k8s-worker has CIDR [10.244.1.0/24] ","level_name":"INFO","clean_status":"success","processed_at":"2026-04-02 09:03:31 +0000","processed_by":"fluentd-aio-cleaner"}

|